É um erro capital teorizar antes de se ter as informações

Sherlock Holmes

E você? Como tomas suas decisões?

Tem o apoio de informações precisas e sempre atualizadas sobre o seu negócio?

E você? Como tomas suas decisões?

Tem o apoio de informações precisas e sempre atualizadas sobre o seu negócio?

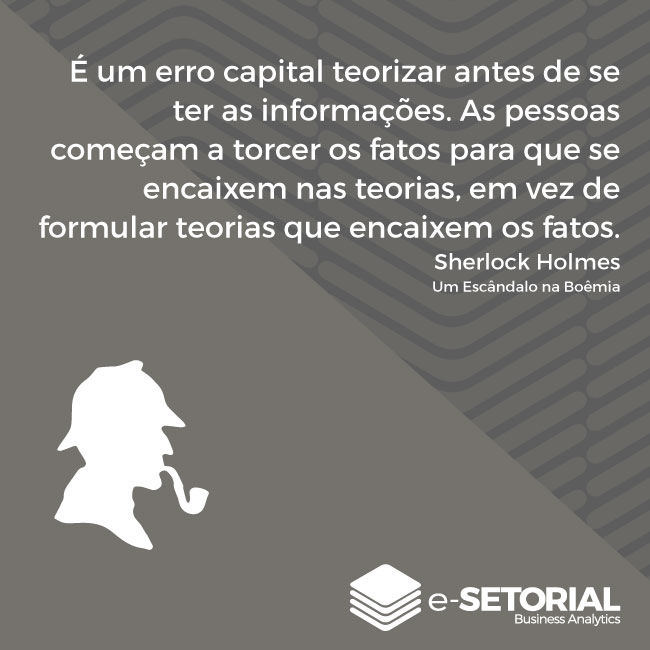

Poucos empresários sabem que existem outras opções disponíveis no mercado e por isso se sentem obrigados a gastar quantias absurdas com softwares obsoletos, mal escritos e pouco funcionais, que necessitam de licenças periódicas, hardwares incrivelmente potentes, além é claro, dos consultores mais caros do planeta.

Este cenário existe ainda hoje com empresas adotando seus softwares de ERP (Planejamento de Recursos Empresariais), CRM (Gestão de Relacionamento com o Cliente) e, claro, com soluções de BI-Business Intelligence (Inteligência de Negócios).

Verdadeiras fortunas são investidas e na maioria das vezes sem que sejam atingidos os objetivos propostos para o projeto. Normalmente estas soluções se limitam a fazer o mínimo necessário, cumprindo apenas com a parte transacional, por exemplo, emitindo uma nota fiscal, mas pecando com a parte analítica, por exemplo, com a falta de um painel interativo que informe em um único local, de forma visualmente clara e agradável, os totais de vendas de cada grupo de produtos, por filiais, ao longo do tempo.

Um balanço na árvore - Figura clássica para quem é da área da TI, mas, infelizmente, pouco conhecida por empresários.

Deslize para o lado para ver o conteúdo completo

Crie uma Solução de Apoio à Decisão sob medida para o seu negócio e aumente a lucratividade sem desperdiçar um Real em licenças de uso.

#OpenSource #Agile #ROI #Clássico

"Você me oferece os Dados e eu a Verdade."

Tome decisões inteligentes.

Em junho deste ano, a empresa Tail Target, em parceria com grupos de usuário, fez um estudo sobre o perfil do desenvolvedor Java no Brasil. Para isso, divulgou entre os desenvolvedores um link que deveria ser clicado por quem quisesse participar da pesquisa.

Este link não continha uma pergunta sequer nem levava para nenhum questionário. Imediatamente, choveram e-mails avisando que o link divulgado estava errado. Não estava. Em menos de uma semana estava pronto um estudo completo que mostrava os interesses, demografia e estilo de vida dos desenvolvedores. Mágica? Não, Data Science.

Data Science é um novo campo que alia Big Data, processamento estatístico e inteligência artificial para encontrar informações e detectar padrões. É cada vez mais comum encontrar grandes empresas cuja tomada de decisão está baseada em Data Science.

Para outras, Data Science é fundamental para a própria existência do seu negócio. No Netflix, 75% da audiência vem do seu algoritmo de recomendação, que é um ótimo exemplo de Data Science aplicada. A plataforma de relacionamentos e-Harmony usa Data Science para encontrar o par ideal para uma pessoa e já é responsável por 5% dos casamentos nos EUA.

O estudo sobre o perfil do desenvolvedor Java analisou dados de navegação anônimos de centenas de pessoas que visitaram um dos sites sobre desenvolvimento Java que estavam sendo monitorados. Fazendo uma análise sobre que outros sites estas pessoas visitavam, algoritmos de inteligência artificial detectaram padrões que permitiram traçar um perfil comportamental dessas pessoas.

Segundo esse estudo, 88% dos desenvolvedores Java brasileiros são homens e apenas 12% são mulheres. Os adultos representam a maioria desses desenvolvedores (44%), seguidos de jovens adultos (30%) e adolescentes (25%). Finanças, tecnologia, futebol, viagens e TV, nessa ordem, são os assuntos que mais interessam os desenvolvedores.

A surpresa nesse estudo veio ao medir os microssegmentos que mais interessavam aos desenvolvedores homens e mulheres. Entre os homens, os principais microssegmentos são TV Aberta, novelas, carros de alta renda, séries de TV e viagens internacionais. Já as mulheres preferem ler sobre TV Aberta, TV a cabo, cabelo e maquiagem. Ou seja, os desenvolvedores homens são noveleiros. As desenvolvedoras não.

Os algoritmos aplicados não coletam informações demográficas nem qualquer informação fornecida pelos usuários. O que eles fazem é processar registros de acesso a milhares de sites e executar uma série de algoritmos de inteligência artificial que tentam adivinhar as informações demográficas e os interesses baseado no comportamento online dessas pessoas.

Obviamente existe uma margem de erro nesses algoritmos, mas eles têm se tornado cada vez mais precisos. Depois da publicação deste estudo, um pesquisador da Universidade de Kent enviou os dados de uma pesquisa similar feita em 2003. Esse estudo usou métodos tradicionais: entrevistas e questionários para encontrar a demografia do desenvolvedor Java. O estudo de 2003 identificou que 88% dos desenvolvedores eram homens. Esse é exatamente o mesmo número encontrado pelos algoritmos que fizeram o mesmo levantamento usando dados comportamentais.

*Fabiane Nardon é PhD em Engenharia Eletrônica pela Escola Politécnica da USP, Mestre em Ciência da Computação pela Universidade Federal do Rio Grande do Sul e Bacharel em Ciência da Computação pela Universidade de Passo Fundo. Desde 2012, é a Cientista Chefe da Tail Target.

fonte

"Em Deus nós confiamos; todos os outros devem trazer dados."

"In God we trust; all others must bring data."

Tome decisões inteligentes.

O Bing incomoda o Google. O buscador da Microsoft, que foi lançado em 2009, conquistou 17% do mercado americano - e, se for somado com o Yahoo (que também utiliza a tecnologia de buscas da Microsoft), chega a 30,8%. Por isso o pessoal do Google passou a acompanhar o concorrente de perto. E a notar que certos resultados do Bing ficavam cada vez mais parecidos com os apresentados pelo próprio Google. Plágio?

As suspeitas recairam sobre a Bing Toolbar, uma barrinha de ferramentas distribuída pela Microsoft. Esse programa traz atalhos para fazer pesquisas mais rapidamente. E também monitora, com o consentimento do usuário, a navegação: vê no que a pessoa clicou e manda essas informações para a Microsoft, que usa os dados para aperfeiçoar o Bing. Acontece que de vez em quando os usuários da Bing Toolbar também faziam pesquisas no Google. E quando isso acontecia... Bingo. A Microsoft gravava os resultados gerados pelo Google, via em quais deles as pessoas clicavam e incorporava tudo a seu próprio buscador. Plágio.

Em uma manobra digna de filme, os engenheiros do Google criaram uma armadilha para flagrar a Microsoft. Funcionou. O Google conseguiu gerar uma prova de que estava sendo copiado (veja infográfico ao lado). E partiu para o ataque. "Alguns resultados do Bing parecem uma versão velha e incompleta dos nossos", fustigou o engenheiro Amit Singhal, do Google. A Microsoft respondeu dizendo que, sim, emprega dados colhidos pela Bing Toolbar para melhorar seus resultados - mas que isso é apenas uma das muitas referências que utiliza. "Definitivamente nós não copiamos os resultados de pesquisa do Google", defende-se Stefan Weitz, diretor do Bing.

Este garoto tem futuro! Já está quase bom para tentar uma vaga de estagiário aqui com a equipe de data-ninjas da e-Setorial!!

O americano Lucas Etter conseguiu o feito em apenas 4,09 segundos.

O garoto Lucas Etter, de 14 anos, de Kentucky, nos Estados Unidos, bateu o recorde de resolução mais rápida de um cubo mágico. Ele foi o primeiro a conseguir o feito em menos de cinco segundos, resolvendo o desafio em 4,09 segundos.

O Guinness World World Records confirmou o novo recorde de Etter e afirmou que o menino ter conseguido o feito foi muita coincidência: apenas horas antes, naquele mesmo dia, um rapaz chamado Keaton Ellis tinha batido o recorde anterior. Ellis conseguiu com o tempo de 5,09 segundos, um segundo a mais do que Etter.

O adolescente de Kentucky compartilhou um vídeo com a sua reação. Vale assistir:

"É um erro capital teorizar antes de se ter as informações. As pessoas começam a torcer os fatos para que se encaixem nas teorias, em vez de formular teorias que encaixem os fatos."

Um Escândalo na Boêmia